Los ordenadores no quieren humanizarse

Esta frase es, al menos, tan antigua como la victoria de Deep Blue en 1997 sobre el entonces campeón mundial de ajedrez Garry Kasparov, pero incluso con los grandes avances realizados en el campo de la inteligencia artificial todavía no tenemos que preocuparnos por los sentimientos de los ordenadores.

Los ordenadores pueden analizar los sentimientos que expresamos en las redes sociales y podemos ver expresiones faciales en los robots para hacernos creer que están felices o enojados, pero nadie cree seriamente, que puedan experimentar sentimientos.

Sin embargo, otras facetas de la Inteligencia Artificial, han visto avances impresionantes tanto en hardware como en software en los últimos 12 meses.

Deep Blue era un oponente de ajedrez de primer nivel que no se regocijaba cuando ganaba o se enfadaba cuando perdía. Hasta este año, sin embargo, los ordenadores no igualaban a un humano en otro juego de mesa, Go. Esto cambió en marzo cuando AlphaGo, desarrollado por la subsidiaria de Google DeepMind, venció a Lee Sedol, entonces el jugador más fuerte del mundo, 4-1 en un torneo a cinco partidas.

El arma secreta de AlphaGo era una técnica llamada aprendizaje del refuerzo, en la que un programa calcula cuáles son las acciones que lo aproximan a su objetivo y refuerza esos comportamientos, sin necesidad de que una persona le enseñe qué pasos son correctos. Eso significaba que podía jugar repetidamente contra sí mismo y aprender gradualmente qué estrategias le salían mejor.

Las técnicas de aprendizaje de refuerzo han existido por décadas, también, pero es recientemente cuando los ordenadores han tenido suficiente capacidad de procesamiento (para probar cada ruta posible) y la memoria (para recordar qué pasos llevaron a la meta) para jugar a alto nivel a una velocidad competitiva.

El hardware con mejor rendimiento impulsa la IA

En mayo, Google reveló su TPU (Tensor Processing Unit), un acelerador de hardware para su algoritmo de aprendizaje profundo TensorFlow. Los ASIC (circuitos integrados específicos de la aplicación) pueden ejecutar los tipos de cálculos utilizados en el aprendizaje de máquinas mucho más rápido y con menos potencia que las GPUs, y Google ha instalado varios miles de ellos en sus servidores en las ranuras previamente reservadas para discos duros.

El TPU fue una de las razones por las que AlphaGo funcionó tan rápido, pero Google también ha utilizado el chip para acelerar las funciones de mapas y navegación en Street View y mejorar los resultados de búsqueda con una nueva herramienta AI llamada RankBrain.

Google mantiene TPU para su uso propio, pero otras empresas están lanzando hardware adaptado para aplicaciones de IA. Microsoft, por ejemplo, ha equipado algunos de sus servidores Azure con FPGAs ( Field Programmable Gate Array Field Programmable Gate Array) para acelerar ciertas funciones de aprendizaje de la máquina, mientras que IBM está señalando similares con una gama de servidores PowerAI que utilizan hardware personalizado para vincular sus Power CPU con GPUs Nvidia.

Para las empresas que quieren implementar tecnologías de vanguardia de IA sin desarrollar todo desde cero, el acceso al hardware de alto rendimiento es el principio, pero suficiente. Los operadores de la nube reconocen esto, y están ofreciendo el software de IA como servicio. Amazon Web Services y Azure de Microsoft han agregado APIs de aprendizaje de máquinas, mientras que IBM está construyendo un negocio alrededor del acceso a la nube a su IA de Watson.

El hecho de que estas herramientas de hardware y software estén basadas en la nube también ayudará a los sistemas de IA.

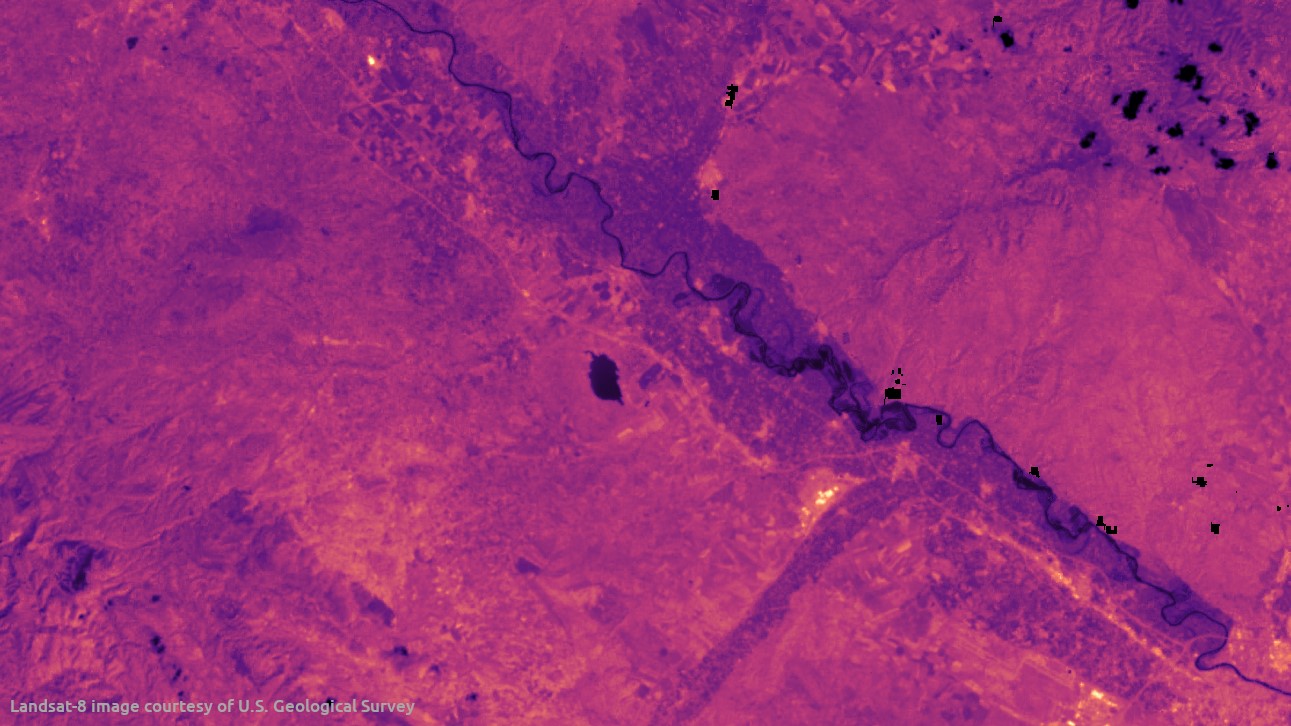

Ser capaz de almacenar y procesar enormes volúmenes de datos sólo es útil para la IA que tiene que acceder a grandes cantidades de datos para aprender, por ejemplo, si su información sobre el clima. El acceso a todos esos datos en bruto, en lugar del subconjunto minucioso, procesado y etiquetado por los humanos, que estaba disponible para las generaciones anteriores, es uno de los factores fundamentales que transforman la investigación de la IA hoy en día, según un estudio de la Universidad de Stanford.